الذكاء الاصطناعي يُراقبك! كيف تتخلص من تطفل جوجل على صورك ورسائلك؟

عندما أعلنت جوجل عن إضافة تقنية فحص (Scan) الصور عبر الذكاء الاصطناعي إلى هواتف أندرويد، اندلعت موجة من الغضب والانتقادات، حيث اتُهمت الشركة بتثبيت أدوات مُراقبة خفية دون علم المُستخدمين أو موافقتهم. في البداية، دافعت جوجل عن تقنية SafetyCore مؤكدةً أنها مُجرّد نظام داعم لا يفحص المُحتوى تلقائيًا، بل يوفر نظام محلي لتصنيف المُحتوى غير المرغوب فيه مثل الرسائل الاحتيالية أو الصور الضارة، مع ترك السيطرة الكاملة للمُستخدمين.

لكن اليوم، أصبحت هذه التقنية حقيقةً ملموسةً مع تحديث رسائل جوجل، الذي بدأ في تشويش الصور العارية وإظهار تحذيرات حول المُحتوى الحساس، والذي أثار تساؤلات جديدة حول حدود المُراقبة الرقمية.

اقرأ أيضًا:

Lark vs Google Workspace: من الأفضل لفريقك في 2025؟

استبدل Google بـ ChatGPT كـ محرك بحث افتراضي في متصفحك الآن!

كيف تعمل ميزة جوجل الجديدة؟

وفقًا لتقارير، يعمل النظام الجديد على الجهاز دون إرسال البيانات إلى سيرفرات جوجل، باستخدام نماذج الذكاء الاصطناعي المحلية لتحليل الصور والرسائل. وتشمل الوظائف:

- تشويش الصور التي يُحتمل أن تكون عارية أو مُسيئة.

- تحذيرات مُسبقة عند مُحاولة إرسال مُحتوى حساس، مع خيارات للحظر أو الإرسال.

- حماية الأطفال عبر تفعيل الميزة افتراضيًا لحساباتهم، بينما تظل اختيارية للبالغين.

أكّدت إحدى منصات أندرويد المُخصصّة للخصوصية أنّ SafetyCore لا يُشارك البيانات مع جوجل، لكنها انتقدت عدم شفافية الكود المصدري للنماذج المُستخدمة، وهذا يحد من قدرة المُطورين والمُستخدمين على التحقُّق من مدى أمانها.

المخاوف المُتعلقة بالخصوصية

رغم الضمانات التقنية، فإن التوقيت يُثير القلق، خاصةً في ظل الضغوط الحكومية المُتزايدة لمُراقبة المُحتوى المُشفّر. تُظهر هذه الخطوة كيف يمكن تحويل أدوات “الحماية” إلى أدوات مُراقبة، حتى لو بدأت بأهداف نبيلة. وتكمن المشكلة في:

- غياب الشفافية: عدم إتاحة كود SafetyCore مفتوح المصدر يترك مجالًا للتساؤل حول دقة النماذج وإمكانية استغلالها بعد ذلك.

- إعادة التثبيت التلقائي: يمكن إزالة التطبيق يدويًا، لكنه قد يعود مع تحديثات “Google Play Services”، والذي يفرض على المُستخدمين مُراقبة هواتفهم باستمرار.

- التوسُّع في المُراقبة: مع تطبيق الميزة أولًا على الرسائل، قد تمتد إلى تطبيقاتٍ أخرى مثل صور جوجل، التي تختبر حاليًا مُشاركة الألبومات عبر رموز QR، ممّا يزيد مخاطر الاستغلال من قبل المُحتالين.

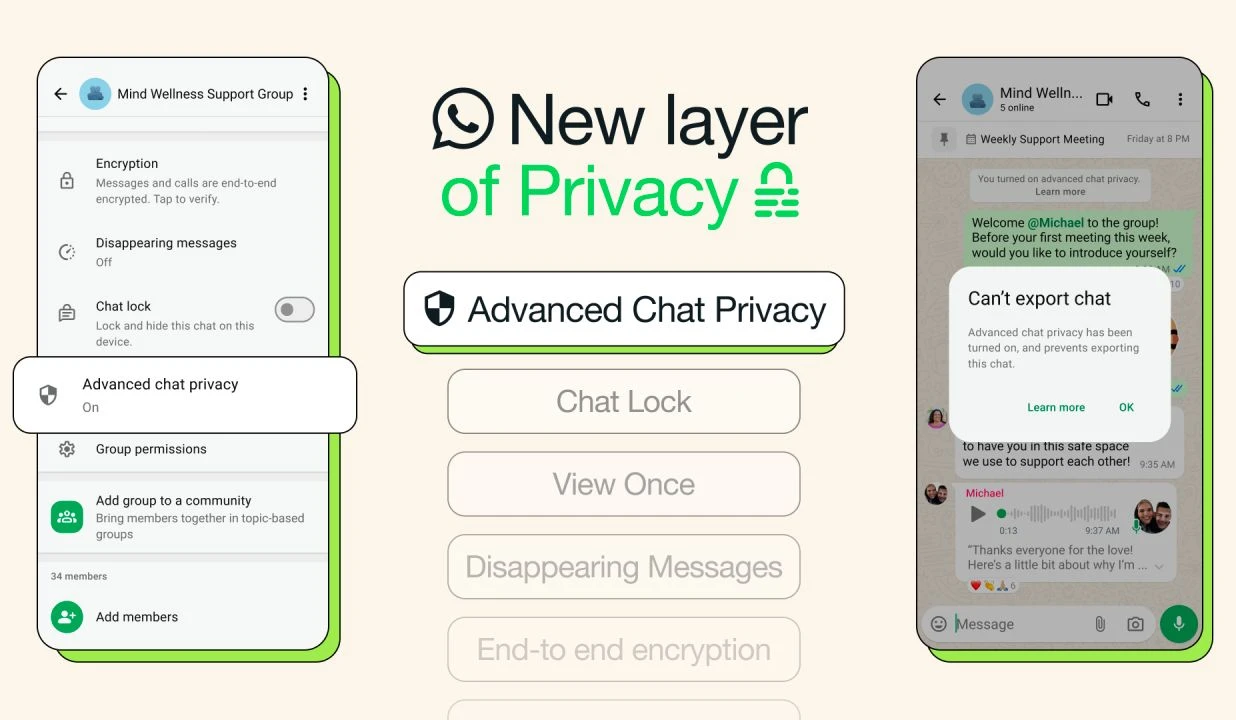

ليست جوجل وحدها في هذا الجدل. فقد أضاف واتساب (المملوك لـ ميتا) مؤخرًا ذكاءً اصطناعيًا توليديًا (Meta AI) يمكنه الرد على الأسئلة أو توليد أفكار، لكنه أثار مخاوف مُستخدميه رغم كونه “اختياريًا”. ولتهدئة الانتقادات، أطلق واتساب إعداد “خصوصية مُتقدمة للدردشة” الذي يُعطّل ميزات الذكاء الاصطناعي في الدردشات المُحدّدة، لكنه لم يقدم خيار حذفها تمامًا.

كيف يمكن للمُستخدمين حماية أنفسهم؟

تعطيل ميزات الذكاء الاصطناعي: في رسائل جوجل، يمكن إلغاء تفعيل “تحذيرات المُحتوى الحساس” من الإعدادات. وفي واتساب، يُنشّط وضع الخصوصية المُتقدمة.

- إزالة SafetyCore: عبر إعدادات الهاتف أو متجر جوجل بلاي، مع التأكُّد من عدم عودته بعد التحديثات.

- الحذر من رموز QR: خاصةً في صور جوجل، حيث يمكن أن تكون وسيلة للاختراق إذا تم تزييفها.

بينما تُقدم جوجل وميتا هذه الميزات كخطوات نحو “إنترنت أكثر أمانًا”، يبقى السؤال: هل الموازنة بين الحماية والخصوصية مُمكنة؟ مع وجود 3 مليار مستخدم لأندرويد وواتساب، يصبح القرار فرديًا: إمّا تقبُّل مُراقبة الذكاء الاصطناعي مُقابل الحماية، أو تعطيلها مع تحمُّل المسؤولية الكاملة.

في النهاية، كما كتبت الجارديان: “إذا كنت لا تدفع ثمن المنتج، فأنت نفسك المنتج”. وهذه هي المُعادلة التي يجب أن يتذكرها الجميع في عصر الذكاء الاصطناعي.

?xml>